Gobernanza de la IA: Cómo la regulación, la colaboración y la demanda de habilidades están configurando las tendencias

Mitigar los riesgos de la IA puede conducir a una ventaja competitiva y contribuir fundamentalmente al éxito de las organizaciones. Image: Unsplash/Google DeepMind

Heather Domin

Global Leader, Responsible AI Initiatives, IBM Office of Privacy & Responsible Technology.- La IA está transformando las industrias, lo que lleva a una creciente demanda de soluciones innovadoras y de profesionales capacitados para abordar las necesidades de gobernanza.

- El autogobierno de los sistemas de IA requiere controles tanto organizacionales como técnicos para responder a una actividad reguladora nueva y en constante cambio.

- El camino a seguir para la IA es abierto y colaborativo, con la automatización necesaria para escalar con una adopción responsable.

La inteligencia artificial (IA) está transformando todos los sectores a medida que los líderes reconocen el potencial de la tecnología para mejorar la productividad, potenciar la creatividad, impulsar la calidad y generar nuevas soluciones. Esto ha creado un aumento de la demanda de IA y, en particular, de la IA generativa.

Desbloquear el valor de la IA generativa con una transformación responsable puede cambiar el juego. Los casos de uso de la IA generativa pueden encontrarse en diversas industrias, desde inspirar nuevos diseños de muebles y personalizar el marketing hasta acelerar el descubrimiento de fármacos en la industria farmacéutica.

Sin embargo, junto con el valor potencial de la IA, los líderes también están preocupados por sus riesgos, incluidos el sesgo, la seguridad, la protección y la pérdida de reputación en caso de que algo salga mal.

Muchos líderes también reconocen que mitigar estos riesgos puede conducir a una ventaja competitiva y contribuir fundamentalmente al éxito de su organización. Por lo tanto, adoptar la tecnología ética y responsablemente se ha convertido en una consideración clave, lo que ha llevado al rápido surgimiento y adopción de la gobernanza de la IA.

Regulación de la IA en expansión

La IA ya está sujeta a normativas aplicables que van más allá de la tecnología misma. Por ejemplo, las leyes se centran en la privacidad, la antidiscriminación, las responsabilidades y la seguridad de los productos. Además, la actividad reguladora centrada en la IA está en expansión.

En 2024, la Ley de Inteligencia Artificial de la Unión Europea, o Ley de IA de la UE, finalmente entró en vigor tras años de debate y anticipación. Al igual que el Reglamento General de Protección de Datos (RGPD), esperamos que influya en muchas leyes similares de otras regiones del mundo.

Los responsables políticos de todo el mundo están debatiendo la IA, que en 2023 se mencionó en los procedimientos legislativos con el doble de frecuencia que en 2022. En algunos casos, la actividad reguladora se centra explícitamente en la IA generativa, como las Medidas Administrativas Provisionales para los Servicios de Inteligencia Artificial Generativa de China.

También ha habido un aumento en las actividades relacionadas con los estándares de IA y la colaboración entre jurisdicciones, ejemplificado por las iniciativas impulsadas por la Organización para la Cooperación y el Desarrollo Económico (OCDE), el Instituto Nacional de Estándares y Tecnología de los Estados Unidos (NIST), la Organización de las Naciones Unidas para la Educación, la Ciencia y la Cultura (Unesco), la Organización Internacional de Normalización (ISO) y el Grupo de los Siete (G7).

En 2024, hemos visto una mayor atención a la seguridad de la IA con el lanzamiento de nuevos institutos de seguridad de IA y la expansión de los esfuerzos impulsados por institutos de Estados Unidos, Reino Unido, Singapur y Japón. Además, la nueva Oficina de IA de la UE, creada en virtud de la Ley de IA de la UE, se centrará en desarrollar mejores prácticas.

Podemos esperar que este crecimiento en el volumen y la variedad de reglamentos y estándares de IA continúe en el futuro previsible, a medida que los responsables políticos lidian con la forma de gestionar los riesgos de la IA. Los acuerdos internacionales sobre estándares interoperables y requisitos regulatorios básicos desempeñarán un papel importante para permitir la innovación y mejorar la seguridad de la IA.

El autogobierno de la IA requerirá controles tanto organizacionales como técnicos

Muchas organizaciones optan por adoptar enfoques de autogobierno para impulsar aún más la alineación con sus valores organizacionales y construir eminencia.

De hecho, implementar los principios de una organización a menudo implica cumplir con estándares éticos que se extienden más allá de los requisitos reglamentarios. Las organizaciones pueden optar por utilizar métodos y marcos voluntarios como el Marco de Gestión de Riesgos de IA del NIST de EE. UU., el marco y kit de herramientas de verificación AI Verify de Singapur y la plataforma de pruebas de seguridad de código abierto Inspect, del Instituto de Seguridad de IA del Reino Unido.

El autogobierno de los sistemas de IA implicará tanto controles organizacionales como, cada vez más, controles técnicos automatizados. La IA requiere sólidos sistemas de gestión organizacional con controles como los descritos en la norma internacional ISO/IEC 42001.

Los controles técnicos son igualmente importantes que los sistemas socio-técnicos. La automatización a menudo puede ayudarlos, por ejemplo, a través de la automatización en el Equipo rojo o Red teaming (una forma estructurada de probar modelos de IA para identificar problemas y ayudar a protegerse contra comportamientos o resultados dañinos), la identificación de metadatos, el registro, el monitoreo y las alertas.

La automatización será necesaria a medida que la tecnología alcance velocidades e inteligencia que requieran controles en tiempo real. Además, a medida que avancen los estándares armonizados y los controles de seguridad de la IA, muchas organizaciones los adoptarán.

La colaboración entre humanos e IA seguirá siendo importante. Por ejemplo, IBM ha implantado controles organizacionales a través de su Comité de Ética de IA y Programa de Gobierno Integrado y ofrece soluciones para ayudar a los clientes a implantar controles organizacionales y técnicos como watsonx.governance.

La creciente necesidad de profesionales cualificados en IA

A medida que el mercado de la gobernanza de IA continúe expandiéndose rápidamente, habrá una gran demanda de profesionales cualificados en IA que puedan implementar controles organizacionales y técnicos responsables.

El campo de juego irá desde los líderes tecnológicos existentes hasta las nuevas start-ups centradas casi exclusivamente en soluciones de gobernanza de IA, como la gestión de inventarios de IA, la gestión de políticas y la elaboración de informes.

El mercado evolucionará para apoyar a áreas especializadas como la gestión de incidentes, el equipo rojo (red teaming), las evaluaciones de conformidad, los informes de transparencia y la documentación técnica. A medida que esto ocurra, será necesario que el número de profesionales capacitados en gobernanza de IA crezca para apoyarlo.

Estos profesionales necesitarán formación para realizar tareas específicas a las demandas del mercado, incluso las tareas exigidas por la normativa. Los programas de educación y certificación desempeñarán un papel fundamental. De hecho, ya hemos visto aparecer nuevas opciones de certificación, como la certificación de Profesional de Gobernanza de Inteligencia Artificial de la Asociación Internacional de Profesionales de la Privacidad.

Si bien existen costos asociados con la capacitación de profesionales y la implementación de prácticas de ética y gobernanza de IA de manera más amplia, los costos de no hacer estas cosas pueden ser aún más altos.

Las organizaciones pueden aprovechar un enfoque holístico para evaluar el retorno de la inversión examinando no solo los rendimientos tradicionales, sino también los retornos obtenidos a través del impacto reputacional y la posibilidad de desarrollar nuevas capacidades organizacionales.

Los líderes deben asegurarse de ver la gobernanza de la IA desde una perspectiva de generación de valor y no puramente de evitación de riesgos.

El camino a seguir es abierto y colaborativo

La IA está cambiando y habilitando la forma en que los seres humanos trabajan y viven, proporcionando beneficios sin precedentes a individuos, organizaciones y la sociedad.

Expandir la IA requiere individuos capacitados y a menudo necesitará automatización para apoyar una adopción responsable. Estos profesionales también pueden apoyar la creciente necesidad de cumplimiento normativo efectivo y autogobierno.

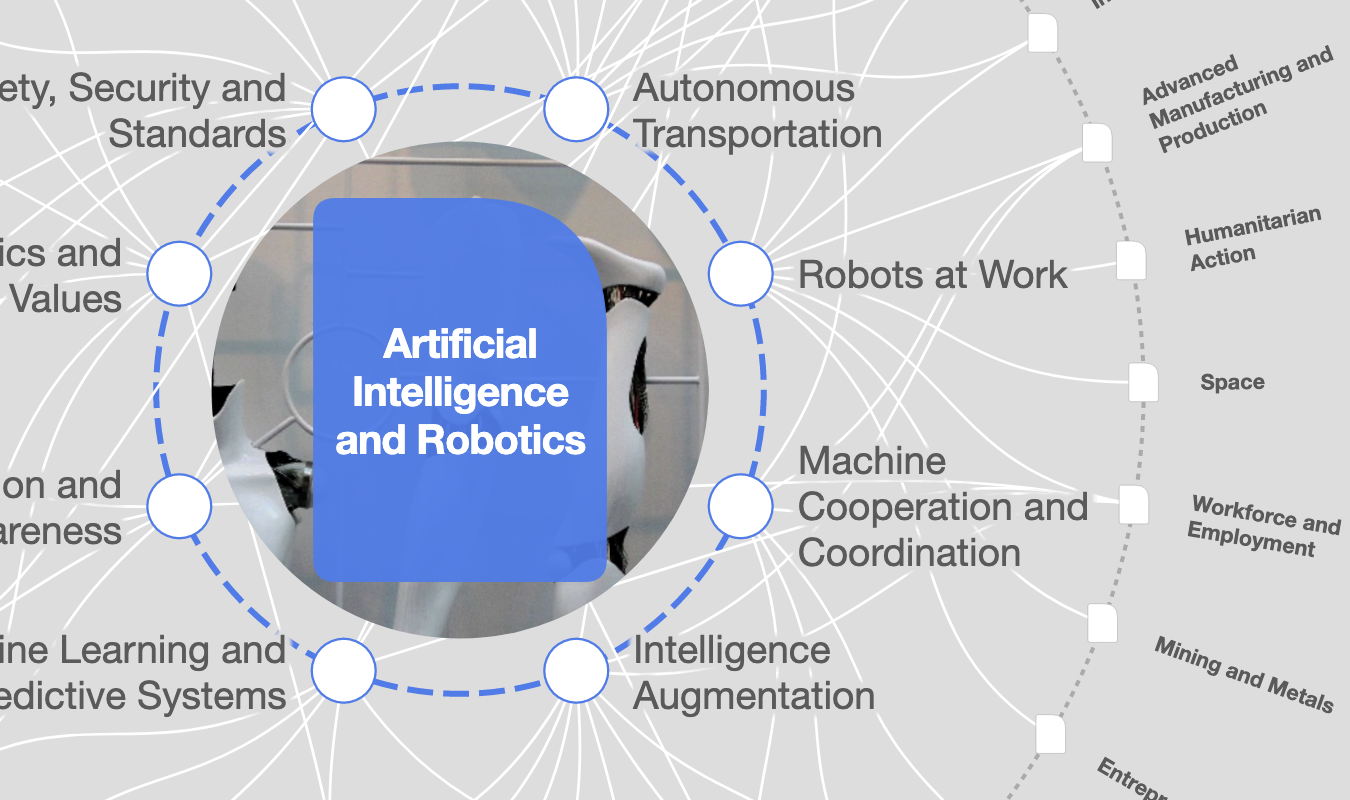

¿Qué está haciendo el Foro Económico Mundial en el ámbito de la cuarta revolución industrial?

Si bien las empresas actualmente están encontrando nuevas formas emocionantes de usar la IA, el futuro tiene aún más promesas a medida que converge con otras tecnologías como la cuántica, la robótica, la biotecnología y la neurotecnología.

En este contexto, la tecnología abierta y la colaboración con diversas partes interesadas serán fundamentales. A medida que la IA transforma las industrias, la gobernanza de la IA es un factor crucial para desbloquear todo el valor de esta tecnología.

No te pierdas ninguna actualización sobre este tema

Crea una cuenta gratuita y accede a tu colección personalizada de contenidos con nuestras últimas publicaciones y análisis.

Licencia y republicación

Los artículos del Foro Económico Mundial pueden volver a publicarse de acuerdo con la Licencia Pública Internacional Creative Commons Reconocimiento-NoComercial-SinObraDerivada 4.0, y de acuerdo con nuestras condiciones de uso.

Las opiniones expresadas en este artículo son las del autor y no del Foro Económico Mundial.

Mantente al día:

Inteligencia Artificial y Robótica

La Agenda Semanal

Una actualización semanal de los temas más importantes de la agenda global

Más sobre Tecnologías emergentesVer todo

Inna Tokarev Sela

13 de noviembre de 2025