Por qué gobernar la IA significa gobernar la cognición

La inteligencia artificial es cada vez más un aspecto fundamental de la vida cotidiana. Image: Unsplash/NASA

- La IA ha pasado de ser una herramienta técnica a una infraestructura fundamental al automatizar el razonamiento y la cognición humanos.

- La cognición delegada aumenta la productividad global al tiempo que centraliza el poder económico e incrementa las demandas de consumo energético.

- La gobernanza futura debe priorizar la agencia humana y la transparencia a medida que los sistemas de IA influyen cada vez más en la toma de decisiones en la sociedad.

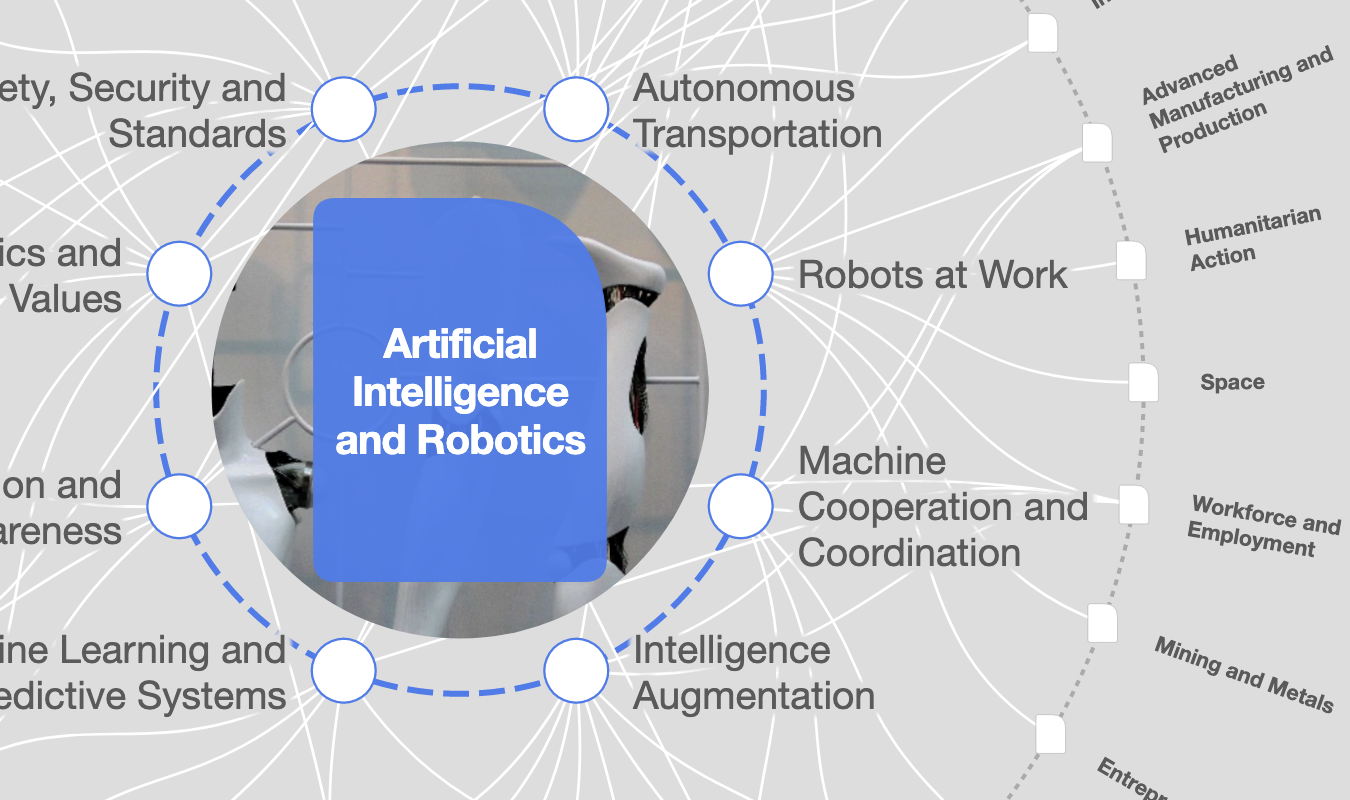

La inteligencia artificial está transitando rápidamente de ser una capacidad técnica especializada a convertirse en un aspecto fundamental de la vida cotidiana. Los modelos de lenguaje ya no están confinados a laboratorios de investigación o flujos de trabajo empresariales. Ahora están integrados en la forma en que las personas escriben, buscan, aprenden y toman decisiones, funcionando cada vez más como compañeros cognitivos.

Este cambio representa más que una mejora tecnológica. Marca una transformación estructural en la forma en que se gobierna la propia cognición. Durante la última década, las plataformas digitales de redes sociales crearon valor económico capturando las huellas conductuales de la interacción cotidiana. Si la última década de transformación digital estuvo definida por la extracción de datos sociales a través de estas plataformas, la fase actual se caracteriza por la delegación del esfuerzo cognitivo a sistemas de IA, con encuestas sobre el trabajo que indican que los empleados ya utilizan herramientas de IA para porciones significativas de su trabajo. Esta transición plantea una pregunta urgente: ¿Qué significa gobernar sistemas que no solo moldean el comportamiento, sino que cada vez más participan en el razonamiento y el juicio?

De las plataformas sociales a la cognición delegada

Las plataformas de redes sociales transformaron la interacción cotidiana en una fuente de valor económico al diseñar la forma en que las personas se conectan, expresan aprobación y comparten atención. Estas plataformas, que cuentan con miles de millones de usuarios, generaron enormes cantidades de datos estructurados y computables a través de acciones estandarizadas. Esta arquitectura permitió una escala sin precedentes. Sin embargo, también concentró el poder interpretativo y económico en manos de unas pocas plataformas digitales dominantes, un cambio reflejado en el último pronóstico global de la industria publicitaria.

Los modelos de lenguaje extienden esta lógica a una capa más profunda de la actividad humana. En lugar de capturar únicamente la interacción social, operan directamente sobre el lenguaje, el principal medio del razonamiento humano. Al hacerlo, permiten una nueva forma de creación de valor basada en la cognición delegada: la externalización de ciertas formas de esfuerzo mental a sistemas automatizados.

Los modelos de lenguaje como infraestructura cognitiva

Los modelos de lenguaje funcionan como un nuevo tipo de infraestructura. Al igual que las plataformas digitales anteriores, están diseñados para ser fluidos y escalables. Sin embargo, a diferencia de las plataformas sociales, su influencia principal reside en cómo las personas comprenden y toman decisiones. Cada interacción revela fragmentos del razonamiento humano. Estos flujos de datos tienen el potencial de generar un valor económico sustancial, estimado en 1,3 billones de dólares para el sector de la IA para 2032, al tiempo que confieren un poder cognitivo significativo. Ese poder radica en moldear qué se vuelve inteligible y susceptible de acción.

Al mismo tiempo, los beneficios de los modelos de lenguaje son considerables. Pueden mejorar significativamente la productividad. Los estudios muestran que los modelos de lenguaje pueden reducir los tiempos de finalización de tareas, con casi la mitad de las tareas en empleos comunes completadas más rápido y una porción sustancial del trabajo en la mayoría de los roles acelerada. También reducen las barreras al conocimiento especializado y permiten la participación a través de divisiones lingüísticas. Al ofrecer síntesis en tiempo real y apoyo para la toma de decisiones, estos sistemas ayudan a individuos y organizaciones a navegar una complejidad que de otro modo exigiría un tiempo considerable y capacidad institucional.

Una característica definitoria del uso contemporáneo de modelos de lenguaje es su creciente papel en la formación de opiniones y el apoyo a la toma de decisiones. Los usuarios consultan cada vez más sistemas de IA no solo para obtener información factual, sino también para recibir orientación en la toma de decisiones cotidianas. Aunque estos sistemas carecen de intención o valores, sus resultados están moldeados por los datos de entrenamiento y las restricciones de diseño. Esto introduce el riesgo del sesgo de automatización: la tendencia a confiar en exceso en los resultados generados por máquinas, porque parecen seguros y neutrales.

Para el usuario cotidiano, la distinción entre asistencia e influencia suele ser poco clara. Los modelos de lenguaje no emiten órdenes, pero su fluidez les confiere autoridad persuasiva. En contextos de bajo riesgo, esto puede parecer benigno. Sin embargo, a gran escala, la dependencia sostenida del razonamiento automatizado plantea importantes cuestiones de gobernanza.

La lógica económica detrás de la cognición delegada

La rápida adopción de los modelos de lenguaje está respaldada por fuertes incentivos económicos. Las inversiones globales en IA alcanzaron los 259 mil millones de dólares solo en 2025. Al igual que con los modelos de plataformas anteriores, el acceso suele estar subsidiado a cambio de datos, mientras que las capacidades premium se monetizan.

La economía de la cognición delegada también conlleva consecuencias materiales. Mientras que las herramientas digitales anteriores distribuían los costos energéticos entre dispositivos y organizaciones individuales, los modelos de lenguaje a gran escala dependen de centros de datos centralizados con una demanda energética significativa y sostenida. En 2024, los centros de datos consumieron alrededor de 415 teravatios-hora de electricidad a nivel global, lo que representa aproximadamente el 1,5 % del uso total de electricidad. Estos centros suelen estar ubicados en jurisdicciones específicas, vinculando actividades cognitivas cotidianas —desde escribir hasta tomar decisiones— con mercados energéticos y regímenes regulatorios distantes. Lo que parece descentralizado a nivel del usuario es, en la práctica, cada vez más centralizado a nivel de la infraestructura.

Esta dinámica refuerza la concentración. El desarrollo y la gobernanza de modelos de lenguaje a gran escala están cada vez más controlados por un pequeño número de actores. A medida que estos sistemas se vuelven infraestructurales, las cuestiones de transparencia y rendición de cuentas se convierten en asuntos de interés público.

Lo que esto significa para la gobernanza de la IA

Para las instituciones de gobernanza global, el auge de la cognición delegada señala la necesidad de evolucionar los marcos existentes de gobernanza de la IA. Muchos enfoques actuales se originan en esfuerzos anteriores por regular la economía de las plataformas, incluidos regímenes de protección de datos como el Reglamento General de Protección de Datos de la Unión Europea y la estructura basada en riesgos del Reglamento de Inteligencia Artificial de la Unión Europea. Estos marcos fueron diseñados para gobernar las prácticas de datos y limitar daños identificables. Aunque siguen siendo necesarios, no fueron concebidos para sistemas que moldean activamente cómo se interpreta la información y cómo se toman decisiones. Los modelos de lenguaje, por lo tanto, funcionan menos como procesadores pasivos y más como intermediarios dentro de los procesos de toma de decisiones.

Este cambio sitúa la agencia humana en el centro de la gobernanza de la IA. A medida que los modelos de lenguaje influyen cada vez más en cómo se formulan los problemas y se priorizan las opciones, la transparencia se convierte en un requisito institucional más que en una salvaguarda técnica. Cuando los resultados mediados por IA afectan resultados en el mundo real, son esenciales líneas claras de rendición de cuentas. Cuando el comportamiento del sistema refleja desequilibrios culturales, la inclusión debe abordarse como una cuestión estructural. La confianza pública dependerá de si los marcos de gobernanza se perciben como orientados al interés público más amplio.

En conjunto, estas dinámicas sugieren que los modelos de lenguaje representan una nueva fase en la evolución de los sistemas digitales: una en la que la propia cognición se convierte en un espacio de automatización y coordinación. A medida que estos sistemas moldean cada vez más cómo individuos e instituciones comprenden y deciden, deben gobernarse no solo como tecnologías, sino como sistemas sociales. Para quienes son responsables de la toma de decisiones públicas e institucionales, la tarea que viene no es resistir la automatización, sino gobernarla de maneras que resguarden la agencia humana en una era de asistencia inteligente.

No te pierdas ninguna actualización sobre este tema

Crea una cuenta gratuita y accede a tu colección personalizada de contenidos con nuestras últimas publicaciones y análisis.

Licencia y republicación

Los artículos del Foro Económico Mundial pueden volver a publicarse de acuerdo con la Licencia Pública Internacional Creative Commons Reconocimiento-NoComercial-SinObraDerivada 4.0, y de acuerdo con nuestras condiciones de uso.

Las opiniones expresadas en este artículo son las del autor y no del Foro Económico Mundial.

Mantente al día:

Generative Artificial Intelligence

La Agenda Semanal

Una actualización semanal de los temas más importantes de la agenda global