Reconocimiento Facial: Los debates por su uso actual

Image: REUTERS/Kwiyeon Ha

El Reconocimiento Facial (RF) es la tecnología que permite identificar a personas particulares basándose en video e imágenes digitales. Ya que cada día interactuamos más con ella, vale la pena preguntarnos, ¿qué es el Reconocimiento Facial? ¿Cómo se aplica en 2019? Y, ¿qué debates abre?

Comenzando la Guerra Fría, George Orwell publicó ‘1984’, una novela distópica que describe una sociedad sin privacidad y bajo vigilancia omnipresente, donde conceptos como el Big Brother, el Cuarto 101 y la policía del pensamiento se volvieron parte del imaginario colectivo, especialmente a partir de la década de 1960. Y es el RF la tecnología que vuelve posible la sociedad descrita por Orwell.

Mientras el RF se comenzó a usar de forma rudimentaria hace décadas para comparar fotografías de detenidos, fue el lanzamiento de la función ‘auto-etiquetar’ de Facebook —que sugería amigos que aparecían en las fotos de los usuarios— la que dio muestra del poder de esta tecnología. La reacción fue de maravilla y miedo a la vez.

La explosión del RF es posible gracias a la convergencia de las redes ubicuas de cámaras, la mejora en cámaras 2D y 3D, bases de datos con millones de fotografías de rostros, la existencia de algoritmos de aprendizaje automático y/o inteligencia artificial, y el procesamiento en milisegundos a través de la nube.

Las personas que desconocen que sin estas tecnologías no habría RF, generalmente se decepcionan aún más al darse cuenta que los seres humanos desarrollamos la habilidad cognitiva de distinguir caras desde la infancia; ni siquiera nos tienen que enseñar a hacerlo.

Entre los usos del RF se encuentran:

- En Nueva Delhi, la policía usó el RF para identificar 3 mil niños perdidos y los pudo reencontrar con sus familias.

- En el Festival Anual de Cerveza de Qingdao, China, las cámaras permitieron detener a una veintena de criminales entre la multitud.

- Las personas ven su smartphone y pueden desde desbloquear su teléfono hasta abrir su casa inteligente.

- En Asia, los dueños de sanitarios combaten el robo de papel de baño pidiendo que el usuario muestre su rostro y solo así se dispense el papel.

- En México, se ha utilizado para distinguir personas que tienen dos identificaciones oficiales, de las cuales una es falsa, así como para confirmar la identidad de personas que viven en complejos residenciales y se van a aprehender.

- La mayoría de los gobiernos que han visto la tecnología, la consideran como un paso más para procesar las fotografías de los ciudadanos con las que ya contaba, para temas de seguridad y de logística aeroportuaria, por ejemplo. Así, las caras procesadas pueden volverse un elemento de análisis añadido al de huellas digitales, entre otros biométricos.

Sin embargo, el caso que resultó un punto de inflexión para la tecnología fue el proyecto de las policías de Orlando, Florida, y Washington County, Oregon, quienes procesaron las fotografías de sus residentes con Amazon Rekognition y desarrollaron aplicaciones para sus policías. En un caso, hicieron una app para que los oficiales comparen las caras de las personas. En una versión más ambiciosa, procesan en tiempo real las videocámaras para identificar personas de interés que están pasando por la calle y que quieran rastrear.

Organizaciones defensoras de la privacidad han protestado por este uso, aduciendo que es demasiado invasivo. Sin embargo, los gobiernos ya van más allá: China ya utiliza 170 millones de cámaras para seguir a las personas que van por la calle, identificar a las que sean posibles y registrar su comportamiento.

A partir de ello, el gobierno chino ha hecho diferentes usos como instalar pantallas donde las personas pueden ver a otras que están siendo grabadas e identificadas, o bien, montar la tecnología en lentes inteligentes para policías que, si el sujeto se queda fijo unos segundos, pueden identificarlo y validar una posible identificación falsa. También ya se conectaron estas cámaras al score social y se están desarrollando algoritmos para tratar de predecir acciones de sujetos sospechosos.

En resumen, la vigilancia ubicua llegó para quedarse con aplicaciones que rebasan los planteamientos de Orwell.

Como sucede en las industrias disruptivas, diferentes jugadores han tratado de aplicar esta tecnología en gran cantidad de casos, algunos sorprendentes: identificar personas por la forma de su cuerpo y de caminar, reconocimiento de quien está volteado de la cámara o en la oscuridad, o uso de la tecnología en animales de consumo humano, comenzando por los cerdos para identificar calidades y enfermedades.

Cada aplicación parece más del terror que la anterior, pero quizá el mayor peligro se centre en las aplicaciones que explotan riesgos altos que no alcanzamos a ver a través de ingeniería y juegos sociales diseñados para extraer y recolectar datos.

En enero de este año, se viralizó el “10 Year Challenge”, un meme aparecido en Facebook que desafía a las personas a publicar una fotografía de hace 10 años junto con una más reciente. Lo que parecía algo inocente y participativo terminó en un debate sobre si es una estratagema para ayudar a entrenar los algoritmos de RF sobre la progresión de la edad en las personas.

Estos ejemplos solo son una muestra representativa para plantear las dimensiones de los debates que abre el uso del RF.

1. Valor económico: Los emprendimientos que la utilizan, la ven como un medio que les permitirá alcanzar la gloria emprendedora, dependiendo de la capacidad de procesamiento y la precisión de reconocimiento. A nivel corporativo, grandes tecnológicas como Microsoft, Amazon, IBM y Google le han apostado fuertemente a motores de RF que rentan a terceros para que se construyan nuevas aplicaciones, lo mismo para los sectores público y privado.

2. Aceptación en nuestra vida diaria: La permeabilidad del RF está normalizando de forma sutil que las personas la acepten en su vida, quieran utilizarla y piensen que es algo ordinario, que ni siquiera requiere atención, seguimiento o un debate sobre su valor y riesgos.

3. Sesgos: Los algoritmos tienen imprecisiones dependiendo de ciertas características. En uno de varios ejemplos, Buolamwini y Gebru de la U. De Stanford demostraron que los algoritmos de Microsoft e IBM fueron menos precisos para reconocer a mujeres de piel oscura. La mala noticia es que, dichos sesgos tienden a desfavorecer a las minorías, y que el efecto se replica en cada aplicación que use el motor de RF. La buena noticia es que, mientras se haga más diverso el procesamiento de datos, podrán mejorar los algoritmos.

4. Derecho a la Privacidad: Los ejemplos presentados dejan claro que la invasión a la privacidad es total y que ésta es ya una reliquia del pasado. Sin embargo, abre debates alrededor de los derechos a ser dejados en paz o a recibir avisos de cuando se está siendo monitorizado.

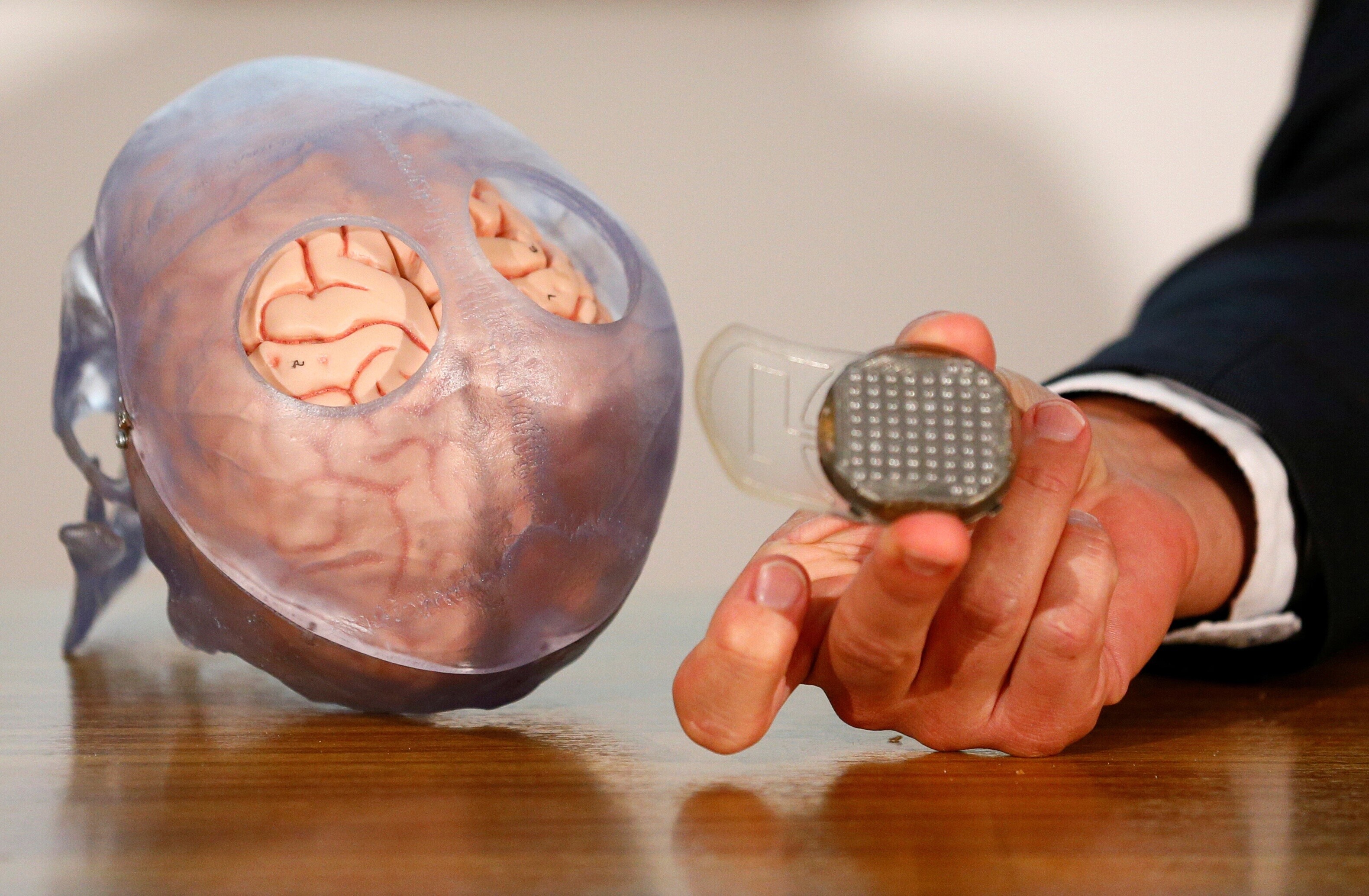

5. Seguridad: El RF es muy útil para acelerar procesos de autenticación, pero no es infalible. Por ejemplo, una empresa británica imprimió una cabeza en 3D a partir de una persona con 50 cámaras alrededor y pudo abrir cuatro teléfonos LG y Samsung operando con Android, lo que dejó la conclusión de que, en el largo plazo, “todos los biométricos pueden ser copiados.”

6. Usos por parte de los gobiernos: Los diferentes usos por parte de los gobiernos los ha confrontado con las asociaciones en defensa de la privacidad, quienes insisten que hay límites que no deben pasar. Dependiendo de la transparencia y el autoritarismo estatal, dichas asociaciones han tenido diferentes grados de éxito en su petición.

Invariablemente, el tema más importante es que, con argumentos como la preservación de la seguridad, los gobiernos están desarrollando estas aplicaciones, sin frenos y balances gubernamentales ni sociales. El debate se centra en los límites normales para el uso de estas tecnologías, pero también en las excepciones, ya que los gobiernos tienden a explotar los estados de emergencia o las razones de seguridad nacional sin rendir cuentas de ello.

7. Regulación: Los seis puntos anteriores se redondean en la necesidad de una regulación de la tecnología, ya que hasta ahora, mucho ha dependido de la autocontención de los desarrolladores de RF. Por ejemplo, Amazon ha seguido una línea de no desarrollar nada explícitamente prohibido y probar la tecnología con gobiernos invitados —haciéndolo público a posteriori—.

Por otro lado, Google ha optado por estudiar a los potenciales clientes de sus herramientas de RF, luego de que retiró del mercado su solución de “propósito general” por el potencial de abuso a la misma. Aún queda que divulgue si usará directrices específicas, cosa que sí hizo para el desarrollo de la Inteligencia Artificial, como parte del consorcio “Partnership on AI.”

Microsoft presentó recientemente sus 6 principios para uso de RF, que constan de justicia, transparencia, rendición de cuentas, no discriminación, notificación y consentimiento, y cumplimiento del marco legal de espionaje.

En la siguiente parte de este texto, analizaré los aspectos regulatorios del RF y qué características podrían incluir una legislación nacional al respecto.

No te pierdas ninguna actualización sobre este tema

Crea una cuenta gratuita y accede a tu colección personalizada de contenidos con nuestras últimas publicaciones y análisis.

Licencia y republicación

Los artículos del Foro Económico Mundial pueden volver a publicarse de acuerdo con la Licencia Pública Internacional Creative Commons Reconocimiento-NoComercial-SinObraDerivada 4.0, y de acuerdo con nuestras condiciones de uso.

Las opiniones expresadas en este artículo son las del autor y no del Foro Económico Mundial.

Mantente al día:

Information Technology

Temas relacionados:

La Agenda Semanal

Una actualización semanal de los temas más importantes de la agenda global

Más sobre CiberseguridadVer todo

Christophe Blassiau, Michael Daniel and Michele Mosca

31 de octubre de 2025