¿Es así como hay que prepararse para un futuro impulsado por IA agéntica?

La IA agéntica se está volviendo rápidamente omnipresente, pero necesita barreras de control. Image: Getty Images/iStockphoto

- La IA agéntica marca un cambio real en la forma en que se realiza el trabajo dentro de una empresa.

- No es solo una evolución tecnológica; es un problema de gobernanza y seguridad que las empresas deben abordar de frente.

- Las organizaciones que tengan éxito en la era de la IA agéntica ganarán autonomía a través de la visibilidad, límites de políticas claros y la capacidad de auditar y anular decisiones cuando sea necesario.

La IA agéntica marca un cambio real en la forma en que se realiza el trabajo dentro de una empresa. Estamos pasando de sistemas que asisten a los humanos a sistemas en los que se confía para razonar, decidir y actuar por sí mismos. Ese cambio ya está en marcha y está ocurriendo dentro de los flujos de trabajo centrales de las empresas, no en laboratorios ni en programas piloto.

Permítanme ser claro sobre por qué esto importa. Cuando a los sistemas de IA se les otorga autonomía, se convierten en actores operativos con autoridad. Inician acciones, interactúan con herramientas y APIs e influyen en los resultados en tiempo real. En ese punto, muchas de las suposiciones en las que se apoyan las organizaciones —sobre control, supervisión y rendición de cuentas— dejan de sostenerse. Esto no es solo una evolución tecnológica. Es un problema de gobernanza y seguridad que las empresas deben abordar de frente.

¿Cómo podemos pasar de la fatiga por alerta a la defensa activa?

La ciberseguridad también aprovechará y desplegará la IA agéntica de maneras más exigentes, incluso en el centro de operaciones de seguridad. Las operaciones de seguridad están bajo una presión constante, con analistas que enfrentan un volumen vertiginoso de alertas, falsos positivos y demandas de respuesta a incidentes. La escala y la velocidad de las amenazas casi han superado la capacidad humana, lo que conduce al agotamiento, la rotación y difíciles compensaciones entre la profundidad de la seguridad y la agilidad del negocio. En muchas organizaciones, la seguridad se ha convertido en un juego de recursos que los humanos por sí solos ya no pueden ganar.

La IA agéntica promete ser el multiplicador de fuerza crítico para ayudar a resolver este desafío. En este contexto, los agentes funcionan como asistentes inteligentes que automatizan la monitorización, el triage y la gestión de eventos de seguridad. Clasifican alertas, enriquecen los eventos con datos contextuales, correlacionan señales entre sistemas dispares y escalan solo aquello que realmente requiere juicio humano. Algunos ya están siendo entrenados para ajustar dinámicamente las políticas de seguridad y acceso a medida que evolucionan los contextos del negocio, monitoreando continuamente el cumplimiento, señalando anomalías en tiempo real y tomando de forma autónoma acciones correctivas limitadas.

Adoptar la IA agéntica debería además desplazar la ciberseguridad de un enfoque reactivo a uno proactivo, ayudando a identificar y prevenir amenazas antes de que puedan dañar a las organizaciones. En lugar de limitarse a alertar sobre actividad sospechosa, la seguridad impulsada por IA se convierte en un sistema de defensa activa, capaz de operar a velocidad de máquina sin sacrificar precisión ni visibilidad. El tiempo medio para detectar y responder se reduce drásticamente, los puntos ciegos se reducen y los analistas humanos recuperan el espacio cognitivo para concentrarse en la estrategia de alto nivel y en investigaciones complejas.

¿Por qué la IA agéntica es una herramienta y no una toma de control?

La eficacia de la IA agéntica en las operaciones de seguridad se basa en la ampliación de capacidades, no en el reemplazo. La experiencia en ciberseguridad sigue siendo escasa y de gran valor. Lo que los agentes hacen excepcionalmente bien es encargarse de las tareas repetitivas y de alto volumen que agotan la atención humana: clasificación de alertas, análisis de registros, investigaciones rutinarias y correlación básica de amenazas. Trabajan de manera continua, sin fatiga, a través de sistemas y silos que pueden ser difíciles de monitorear simultáneamente para los humanos.

Debido a que la IA agéntica puede procesar rápidamente conjuntos masivos de datos y detectar patrones sutiles, puede sacar a la luz amenazas que de otro modo podrían pasarse por alto o descubrirse demasiado tarde. Los primeros despliegues ya están demostrando posturas de seguridad más sólidas, mayor resiliencia operativa y una reducción significativa de los cuellos de botella que ralentizan la respuesta a incidentes. La IA agéntica permite a las organizaciones escalar los resultados en seguridad sin escalar el número de empleados al mismo ritmo.

¿Cómo podemos desplegar y escalar la IA agéntica de manera responsable?

A medida que los agentes de IA se despliegan y escalan dentro de las organizaciones, inevitablemente surgirán nuevas brechas de gobernanza que limitarán la autoridad operativa. ¿Quién valida las acciones de un agente? ¿Quién audita su lógica de decisión? ¿Cómo intervienen las organizaciones cuando la intención de un agente se desvía del resultado deseado o cuando los objetivos de optimización entran en conflicto con restricciones éticas o regulatorias?

La eficiencia autónoma sin rendición de cuentas se convierte rápidamente en un riesgo no gestionado. Un agente que puede cambiar políticas de acceso, aislar sistemas o iniciar acciones de remediación debe ser gobernado con el mismo rigor —si no más— que cualquier usuario humano con privilegios. Sin barreras de control sólidas, observabilidad y auditabilidad, las organizaciones corren el riesgo de cambiar el error humano por fallas sistémicas impulsadas por máquinas.

A medida que la IA agéntica se adopta y escala a un ritmo más rápido, las empresas necesitarán consejos formales de gobernanza de IA que reúnan a líderes de seguridad, riesgo, legales y de negocio. Estos organismos definirán dónde se permite la autonomía, bajo qué condiciones y con qué vías de escalamiento. Las barreras de política deben ser explícitas, aplicables y evaluadas continuamente. Cada decisión autónoma debe registrarse en trazas de auditoría inmutables, lo que permite revisiones posteriores a incidentes, validación de cumplimiento y mejora continua.

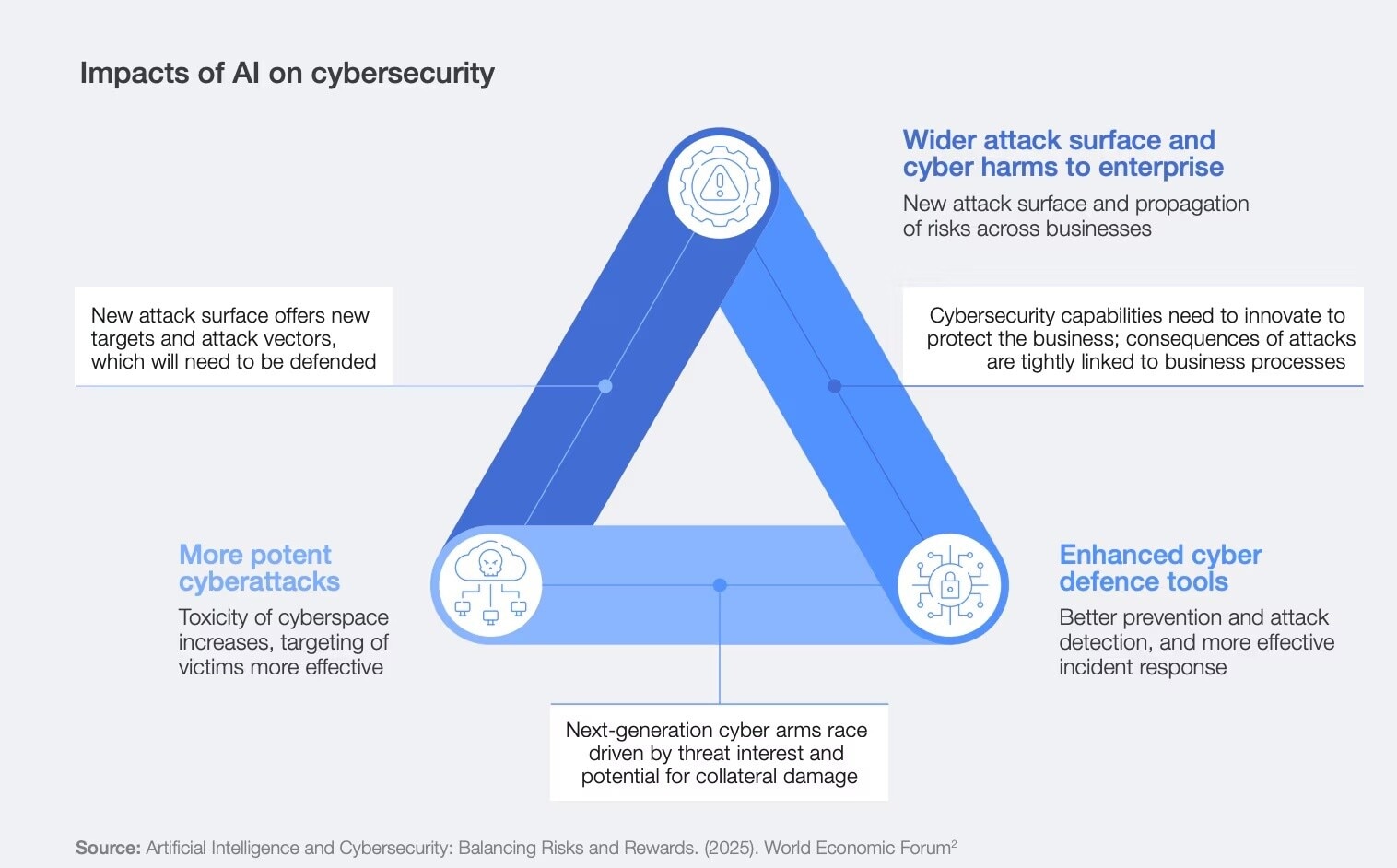

Esta preocupación no es teórica. El Global Cybersecurity Outlook 2026 del Foro Económico Mundial concluye que la aceleración de la adopción de la IA está ampliando la superficie de ataque cibernético, mientras que las organizaciones luchan por alinear la gobernanza, las capacidades y los controles de seguridad con la velocidad de despliegue. A medida que los sistemas y agentes de IA proliferan en los flujos de trabajo empresariales, la ausencia de gobernanza puede resultar más peligrosa que la ausencia de automatización.

El éxito en la era agéntica depende de la visibilidad. Las empresas deben poder observar qué están haciendo sus agentes de IA, por qué lo están haciendo y qué impacto tienen sus acciones en todo el entorno. Esto significa que las plataformas de seguridad deben evolucionar para ofrecer información en tiempo real sobre los comportamientos de los agentes, las rutas de decisión y los resultados. Las políticas deben diseñarse con principios de prevención desde el diseño, asegurando que los agentes operen dentro de límites claramente definidos y alineados con la tolerancia al riesgo de la organización.

Cuando los agentes actúan, los humanos deben poder comprender, auditar y anular esas acciones cuando sea necesario. Después de todo, visibilidad y control van de la mano.

Adversarios autónomos versus defensores autónomos

El desafío de seguridad que se avecina es claro. Los atacantes ya están utilizando IA para automatizar el reconocimiento, adaptar técnicas y operar a velocidad de máquina. Defenderse de eso únicamente con procesos impulsados por humanos ya no es suficiente. Las empresas están entrando en un entorno donde la autonomía existe en ambos lados. El resultado depende de qué tan bien se gobierne esa autonomía.

La IA agéntica no es inherentemente riesgosa. La autonomía sin restricciones sí lo es. Las organizaciones que tengan éxito en la era agéntica serán aquellas que ganen autonomía a través de la visibilidad, límites claros de políticas y la capacidad de auditar y anular decisiones cuando sea necesario. La seguridad en este modelo no consiste en reaccionar más rápido, sino en garantizar que los sistemas autónomos actúen con intención. La inteligencia sin gobernanza no escala. El riesgo sí.

¿Qué está haciendo el Foro Económico Mundial en el ámbito de la cuarta revolución industrial?

No te pierdas ninguna actualización sobre este tema

Crea una cuenta gratuita y accede a tu colección personalizada de contenidos con nuestras últimas publicaciones y análisis.

Licencia y republicación

Los artículos del Foro Económico Mundial pueden volver a publicarse de acuerdo con la Licencia Pública Internacional Creative Commons Reconocimiento-NoComercial-SinObraDerivada 4.0, y de acuerdo con nuestras condiciones de uso.

Las opiniones expresadas en este artículo son las del autor y no del Foro Económico Mundial.

Mantente al día:

Agile Governance

Temas relacionados:

La Agenda Semanal

Una actualización semanal de los temas más importantes de la agenda global

Más sobre Inteligencia artificialVer todo

Kathryn Diaz

30 de marzo de 2026