Las organizaciones subestiman los riesgos asociados a la IA generativa ¿Cómo pueden prepararse?

La IA generativa está cambiando paradigmas, y seguirán surgiendo riesgos en torno a casos de uso específicos. Image: Getty Images/iStockphoto

Mantente al día:

Tech and Innovation

Listen to the article

- Todas las organizaciones subestiman considerablemente el riesgo de la inteligencia artificial (IA).

- Una mala aplicación de la IA puede perpetuar las desigualdades existentes en el lugar de trabajo.

- Examinamos cómo las empresas pueden garantizar el despliegue ético de la IA generativa.

En medio del reciente revuelo en torno a ChatGPT y la inteligencia artificial (IA) generativa, muchos están deseosos de aprovechar el potencial cada vez más sofisticado de esta tecnología.

Sin embargo, los resultados de la encuesta sobre IA en Norteamérica 2022 de Baker McKenzie indican que los líderes empresariales subestiman los riesgos relacionados con la IA para su organización. Solo 4% de los encuestados de nivel C-suite dijeron que consideran que los riesgos asociados con el uso de la IA son "significativos", y menos de la mitad a nivel directivo dijeron tener expertise en IA.

Estas cifras ponen de manifiesto una realidad preocupante: muchas organizaciones no están suficientemente preparadas para la IA y carecen de la supervisión y los conocimientos adecuados por parte de los principales responsables de la toma de decisiones para gestionar los riesgos. Y si no se abordan, es probable que los puntos ciegos de la organización en torno al despliegue ético y eficaz de la tecnología eclipsen las oportunidades de transformación y hagan que las organizaciones pierdan el ritmo del crecimiento explosivo de la tecnología.

¿Cómo está cambiando la IA generativa el panorama del riesgo?

En la actualidad, los avances y la adopción de la inteligencia artificial se producen a un ritmo exponencial, según algunos demasiado rápido.

Aunque este crecimiento exponencial ha renovado la atención sobre el uso de la IA, la realidad es que académicos, científicos, responsables políticos, profesionales del derecho y otros llevan tiempo haciendo campaña en favor del uso y despliegue ético y legal de la IA, especialmente en el lugar de trabajo, donde abundan las aplicaciones existentes de la IA en la función de RR. HH. (por ejemplo, adquisición de talentos, tareas administrativas, formación de empleados).

Según nuestra encuesta, el 75% de las empresas ya utilizan herramientas y tecnología de IA para la contratación y los RR. HH.

En esta nueva fase de la IA generativa, los principios básicos de la adopción de la IA -como la gobernanza, la responsabilidad y la transparencia- son más importantes que nunca, al igual que la preocupación por las consecuencias de una IA mal aplicada.

Por ejemplo, los algoritmos no controlados pueden dar lugar a resultados sesgados y discriminatorios, perpetuando las desigualdades y frenando el progreso de la diversidad de la mano de obra. La privacidad de los datos y las infracciones son otro motivo de preocupación, ya que pueden producirse fácilmente por la falta de anonimización y la recopilación de datos de los empleados.

La IA generativa también ha dado paso a nuevas consideraciones sobre la propiedad intelectual, planteando cuestiones en torno a la propiedad de las entradas y salidas de programas de terceros, y los consiguientes problemas de infracción de los derechos de autor.

En general, hemos visto cómo los gobiernos y los reguladores se han apresurado a aplicar la legislación relacionada con la IA y los mecanismos de aplicación de la normativa. En EE. UU., el foco de la nueva legislación se centrará en el uso de la IA en la contratación y en las operaciones relacionadas con los recursos humanos.

Los litigios, incluidas las demandas colectivas, también están en el horizonte. Ya estamos asistiendo a la primera oleada de litigios sobre la propiedad intelectual de la IA generativa en Estados Unidos, y estas primeras decisiones judiciales están configurando el panorama jurídico a falta de la normativa vigente.

Las organizaciones que apliquen la IA generativa también deben asumir que los datos introducidos en las herramientas y consultas de IA serán recopilados por terceros proveedores de la tecnología. En algunos casos, estos proveedores tendrán derecho a utilizar y/o divulgar estos datos.

A medida que los empleadores tratan de equipar a sus plantillas con herramientas de IA generativa, ¿están poniendo en peligro datos confidenciales y secretos comerciales? En resumen, sí. En definitiva, cada nuevo avance parece abrir interrogantes más rápido de lo que las organizaciones, los reguladores y los tribunales pueden responderlos.

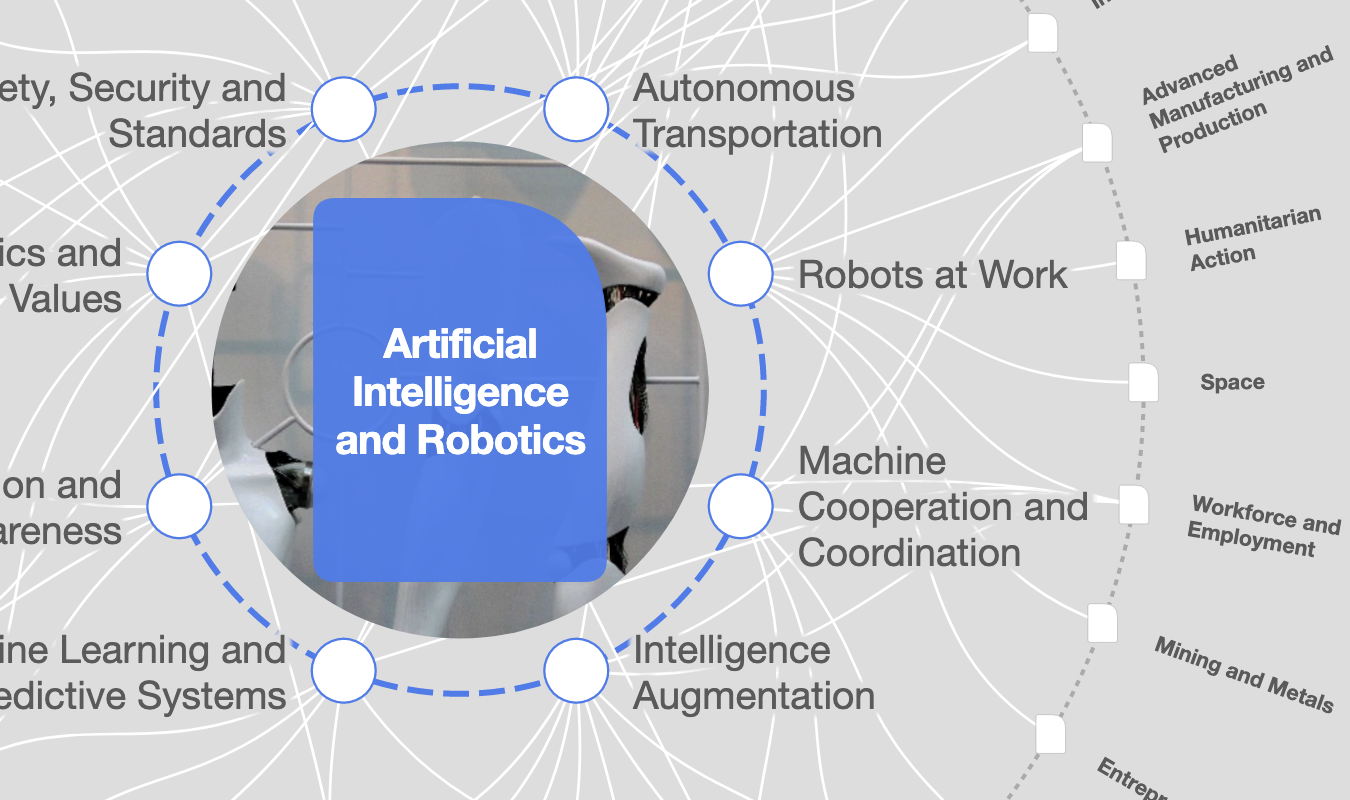

¿Qué está haciendo el Foro Económico Mundial en el ámbito de la cuarta revolución industrial?

¿Cómo pueden las organizaciones mejorar su preparación ante la IA?

La IA generativa está cambiando el paradigma, y seguirán surgiendo riesgos en torno a casos de uso específicos. Para mantenerse a la vanguardia, las organizaciones tendrán que ir más allá de los enfoques aislados y aunar funciones bajo el paraguas de un sólido marco de gobernanza.

Aunque muchas organizaciones confían en los científicos de datos para encabezar las iniciativas de IA, todas las partes interesadas, incluidos los juristas, la alta dirección, los consejos, la privacidad, el cumplimiento y RR. HH., deben participar en todo el proceso de toma de decisiones.

Esta brecha de representación quedó patente en los resultados de nuestra encuesta. En la actualidad, solo el 54% de los encuestados afirma que su organización implica a RR. HH. en el proceso de toma de decisiones sobre herramientas de IA, y solo el 36% de los encuestados afirma contar con un jefe de IA.

En este entorno de alto riesgo, el jefe de IA desempeñará un papel fundamental a la hora de garantizar la gobernanza y la supervisión pertinentes a nivel de la C-Suite e implicará a RR. HH. en la formación y el fomento de un equipo de IA interfuncional.

Junto con esto, las organizaciones deben preparar y seguir un marco de gobernanza interno que tenga en cuenta los riesgos empresariales en todos los casos de uso y permita a la empresa realizar de forma eficaz los ajustes de cumplimiento una vez que se identifiquen los problemas.

El riesgo para las empresas que no cuentan con una estructura de gobernanza de la IA y carecen de supervisión por parte de las principales partes interesadas, o que dependen en su totalidad de herramientas de terceros, es que el uso de herramientas de IA pueda generar responsabilidad jurídica para la organización (por ejemplo, demandas por discriminación).

Prácticamente toda la toma de decisiones, basada o no en la IA, genera sesgos. Las empresas que utilizan estas herramientas deben desarrollar un marco que identifique un enfoque para evaluar los sesgos y un mecanismo para probar y evitar los sesgos ilícitos, así como garantizar el cumplimiento de los requisitos pertinentes en materia de privacidad de datos.

Los esfuerzos para combatir el sesgo deben apoyarse aún más con medidas eficaces para las pruebas previas y posteriores al despliegue.

Las empresas que implantan la IA también deben asegurarse de que existen procesos que proporcionan una comprensión clara de los conjuntos de datos que se utilizan, la funcionalidad algorítmica y las limitaciones tecnológicas, ya que la legislación propuesta probablemente incluirá requisitos de información.

Perspectivas finales de la IA

La conclusión es sencilla: La IA se está adoptando amplia y rápidamente y ofrece muchas ventajas. Pero se está extendiendo y desarrollando con tanta rapidez que la supervisión estratégica y la gobernanza se vuelven aún más críticas para su uso responsable y la mitigación de riesgos.

Muchas organizaciones no están preparadas para la IA y subestiman los riesgos, lo que hace que la voluntad de desplegar esta tecnología sin las barreras adecuadas sea preocupante.

Afortunadamente, mediante el establecimiento de sólidas estructuras de gobernanza y supervisión, las organizaciones pueden resistir estas mareas tecnológicas, independientemente de dónde se encuentren en su viaje hacia la IA.

Más allá de esto, la solución a largo plazo para gestionar los riesgos relacionados con la IA dependerá de que las partes interesadas del sector jurídico, regulador y privado unan sus fuerzas para impulsar la legislación, los códigos de prácticas o los marcos de orientación que reconozcan tanto las oportunidades como los riesgos que presenta la tecnología.

Con un marco seguro, las organizaciones pueden desplegar la tecnología de IA y aprovechar sus ventajas con más confianza.

No te pierdas ninguna actualización sobre este tema

Crea una cuenta gratuita y accede a tu colección personalizada de contenidos con nuestras últimas publicaciones y análisis.

Licencia y republicación

Los artículos del Foro Económico Mundial pueden volver a publicarse de acuerdo con la Licencia Pública Internacional Creative Commons Reconocimiento-NoComercial-SinObraDerivada 4.0, y de acuerdo con nuestras condiciones de uso.

Las opiniones expresadas en este artículo son las del autor y no del Foro Económico Mundial.

Temas relacionados:

La Agenda Semanal

Una actualización semanal de los temas más importantes de la agenda global

Puedes anular tu suscripción en cualquier momento utilizando el enlace que figura en nuestros correos electrónicos. Para obtener más información, consulta nuestro Política de privacidad.

Más sobre Tecnologías emergentesVer todo

Joseph Wehbe

21 de julio de 2024

David Elliott

21 de julio de 2024

Stefanie Ólives

19 de julio de 2024

David Elliott

4 de julio de 2024

Cathy Li

4 de julio de 2024

David Elliott

4 de julio de 2024