La confianza es la piedra angular de la Ley de Inteligencia Artificial de la UE - De esto se trata

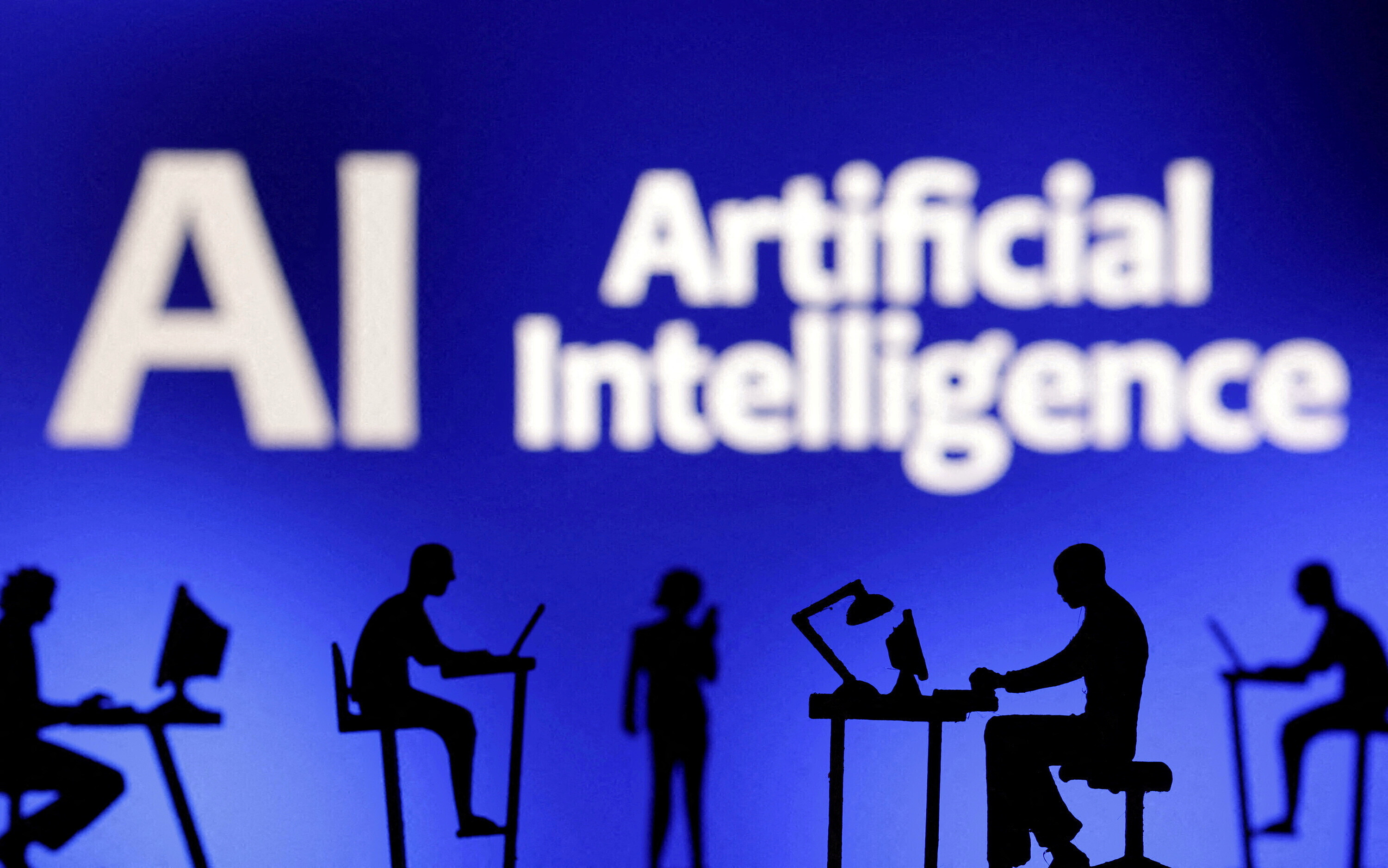

La propuesta de Ley de Inteligencia Artificial clasificaría los sistemas de IA en función de su riesgo e impondría diversos requisitos de desarrollo y uso. Image: REUTERS/Yves Herman

Listen to the article

- La Unión Europea está estudiando una legislación de gran alcance sobre inteligencia artificial (IA).

- La propuesta de Ley de Inteligencia Artificial clasificaría los sistemas de IA por riesgos y exigiría diversos requisitos de desarrollo y uso.

- Los legisladores europeos aún están debatiendo los detalles, y muchos insisten en la necesidad de fomentar la innovación en IA y proteger al público.

La Unión Europea (UE) está estudiando un nuevo marco jurídico que pretende reforzar significativamente la normativa sobre el desarrollo y el uso de la inteligencia artificial (IA).

La legislación propuesta, la Ley de Inteligencia Artificial (en inglés: IA Act), se centra principalmente en reforzar las normas sobre calidad de los datos, transparencia, supervisión humana y rendición de cuentas. También pretende abordar cuestiones éticas y retos de aplicación en diversos sectores, desde la sanidad y la educación hasta las finanzas y la energía.

"[La IA] existe desde hace décadas, pero ha alcanzado nuevas capacidades alimentadas por la potencia de cálculo", declaró Thierry Breton, Comisario de Mercado Interior y de Servicios de la UE. La Ley de Inteligencia Artificial pretende "reforzar la posición de Europa como centro mundial de excelencia en IA desde el laboratorio hasta el mercado, garantizar que la IA en Europa respete nuestros valores y normas, y aprovechar el potencial de la IA para uso industrial".

La piedra angular de la Ley de IA es un sistema de clasificación que determina el nivel de riesgo que una tecnología de IA podría suponer para la salud y la seguridad o los derechos fundamentales de una persona. El marco incluye cuatro niveles de riesgo: inaceptable, alto, limitado y mínimo.

Los sistemas de IA con un riesgo limitado y mínimo, como los filtros de spam o los videojuegos, pueden utilizarse sin más requisitos que las obligaciones de transparencia. Los sistemas que se considera que plantean un riesgo inaceptable -como los sistemas gubernamentales de puntuación social y de identificación biométrica en tiempo real en espacios públicos- están prohibidos con pocas excepciones.

En cuanto a la inteligencia artificial, la confianza es una necesidad, no algo agradable de tener.

”Los sistemas de IA de alto riesgo están permitidos, pero los desarrolladores y usuarios deben cumplir una normativa que exige pruebas rigurosas, documentación adecuada de la calidad de los datos y un marco de rendición de cuentas que detalle la supervisión humana. La IA considerada de alto riesgo incluye vehículos autónomos, dispositivos médicos y maquinaria de infraestructuras críticas, por nombrar algunos.

La legislación propuesta también esboza normativas en torno a la denominada IA de propósito general, que son sistemas de IA que pueden utilizarse para distintos fines con diversos grados de riesgo. Estas tecnologías incluyen, por ejemplo, sistemas de IA generativa con grandes modelos lingüísticos como ChatGPT.

Ley de Inteligencia Artificial de la UE: cómo aprovechar el potencial de la IA con seguridad

"Con esta ley, la UE toma la iniciativa en el intento de hacer que los sistemas de IA se adapten al futuro que queremos como humanos", declaró Kay Firth-Butterfield, responsable de IA del Foro Económico Mundial.

La Ley de Inteligencia Artificial propone fuertes sanciones por incumplimiento. Para las empresas, las multas pueden alcanzar los 30 millones de euros o el 6% de los ingresos globales. Presentar documentación falsa o engañosa a los reguladores también puede acarrear multas.

"Con estas normas históricas, la UE encabeza el desarrollo de nuevas normas mundiales para garantizar que se pueda confiar en la IA", añadió en un comunicado Margrethe Vestager, Vicepresidenta Ejecutiva para una Europa adaptada a la Era Digital. "Preparadas para el futuro y favorables a la innovación, nuestras normas intervendrán donde sea estrictamente necesario: cuando estén en juego la seguridad y los derechos fundamentales de los ciudadanos de la UE."

La propuesta de ley también pretende crear una Junta Europea de Inteligencia Artificial, que supervisaría la aplicación del Reglamento y garantizaría una aplicación uniforme en toda la UE. Este organismo se encargaría de emitir dictámenes y recomendaciones sobre las cuestiones que se planteen, así como de orientar a las autoridades nacionales.

"La Junta debe reflejar los diversos intereses del ecosistema de la IA y estar compuesta por representantes de los Estados miembros", reza la legislación propuesta.

La Ley de Inteligencia Artificial fue propuesta originalmente por la Comisión Europea en abril de 2021. A finales de 2022, el Consejo Europeo adoptó una posición de enfoque general sobre la legislación, que actualmente se está debatiendo en el Parlamento Europeo.

"La inteligencia artificial es de vital importancia para nuestro futuro", ha declarado Ivan Bartoš, Viceprimer Ministro checo de Digitalización, en una declaración tras la adopción del Consejo. "Hemos logrado alcanzar un delicado equilibrio que impulsará la innovación y la adopción de la tecnología de inteligencia artificial en toda Europa".

Una vez que el Parlamento Europeo adopte su propia posición sobre la legislación, comenzarán las negociaciones interinstitucionales de la UE -un proceso conocido como diálogos tripartitos- para ultimar y aplicar la ley. Los diálogos tripartitos pueden variar considerablemente en el tiempo a medida que los legisladores negocian los puntos conflictivos y revisan las propuestas. Según los funcionarios de la UE, cuando se trata de textos legislativos complejos como la Ley de Inteligencia Artificial, los diálogos tripartitos suelen ser procesos largos.

No te pierdas ninguna actualización sobre este tema

Crea una cuenta gratuita y accede a tu colección personalizada de contenidos con nuestras últimas publicaciones y análisis.

Licencia y republicación

Los artículos del Foro Económico Mundial pueden volver a publicarse de acuerdo con la Licencia Pública Internacional Creative Commons Reconocimiento-NoComercial-SinObraDerivada 4.0, y de acuerdo con nuestras condiciones de uso.

Las opiniones expresadas en este artículo son las del autor y no del Foro Económico Mundial.

Mantente al día:

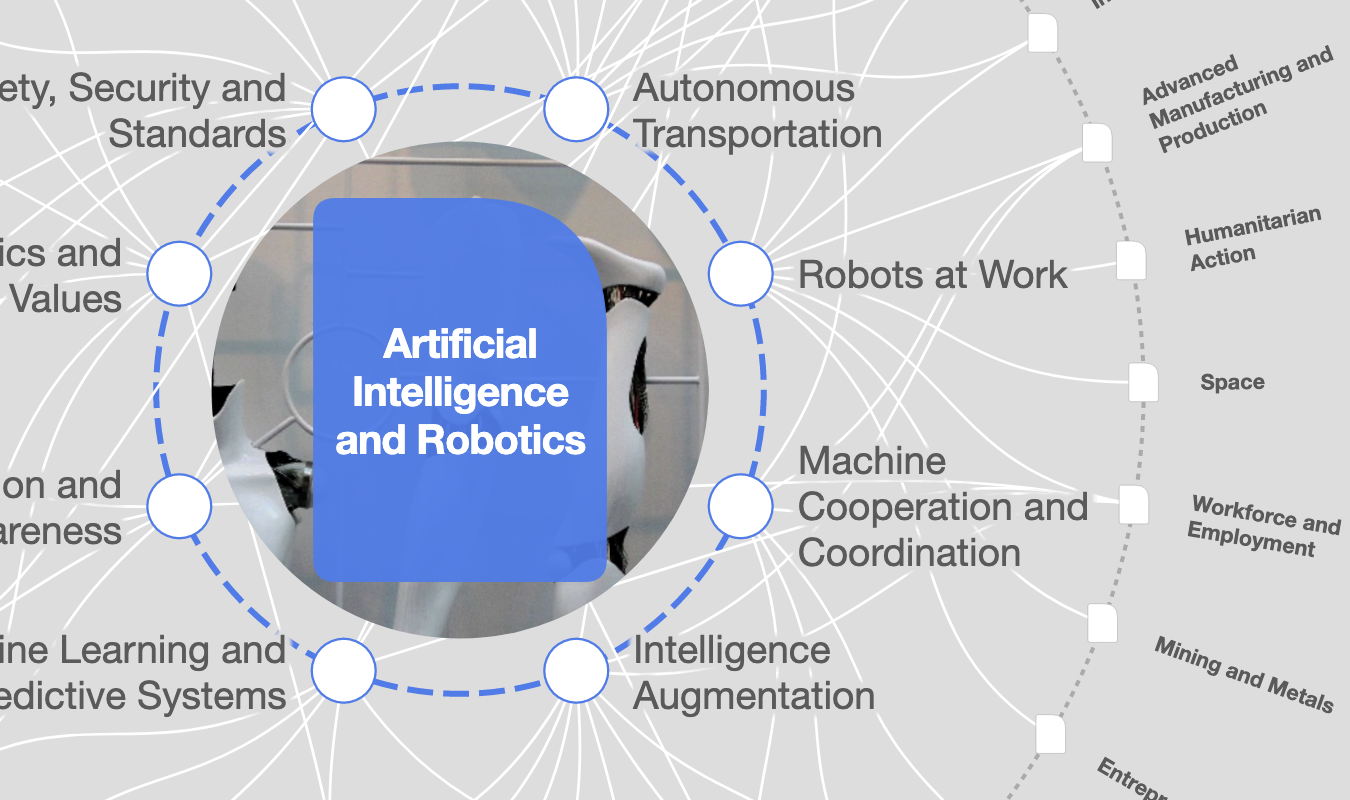

Inteligencia Artificial y Robótica

La Agenda Semanal

Una actualización semanal de los temas más importantes de la agenda global

Más sobre Tecnologías emergentesVer todo

Inna Tokarev Sela

13 de noviembre de 2025